Auditeurs:

Meilleurs auditeurs :

-

play_arrow

play_arrow

Big Bang Radio – HQ+ 320 kbps (AAC+) Big Bang Radio Live

-

play_arrow

play_arrow

Big Bang Radio – HD 1500 kbps (Qualité CD) Big Bang Radio Live

-

play_arrow

play_arrow

Podcast - La géométrie quantique

Google lance Gemma 4

- Publié le

Google lance Gemma 4 : une révolution pour IA open source

Le 2 avril 2026, Google a franchi une nouvelle étape majeure dans le domaine de l’intelligence artificielle avec l’officialisation de Gemma 4. Présenté comme le modèle ouvert le plus performant de sa catégorie, il surpasse largement ses prédécesseurs. Cette nouvelle génération se distingue par une compréhension contextuelle affinée et des capacités de raisonnement logique de très haut niveau, tout en préservant une architecture légère qui favorise le déploiement local. À travers cette initiative, la firme de Mountain View ambitionne de démocratiser l’accès aux outils de pointe pour les chercheurs et les développeurs du monde entier, stimulant ainsi l’innovation au-delà des écosystèmes fermés traditionnels. Cette sortie marque un tournant stratégique décisif, équilibrant la puissance brute d’une IA générative avec une accessibilité sans précédent.

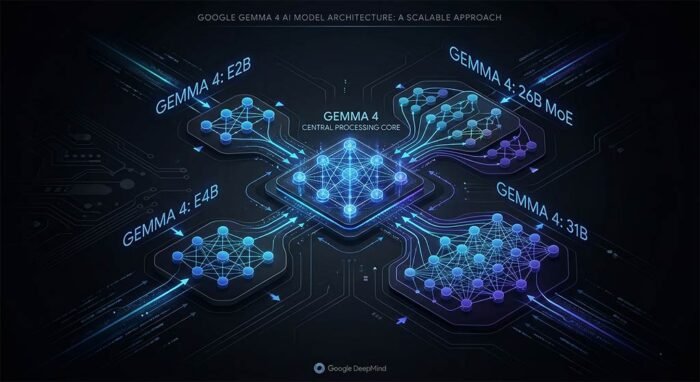

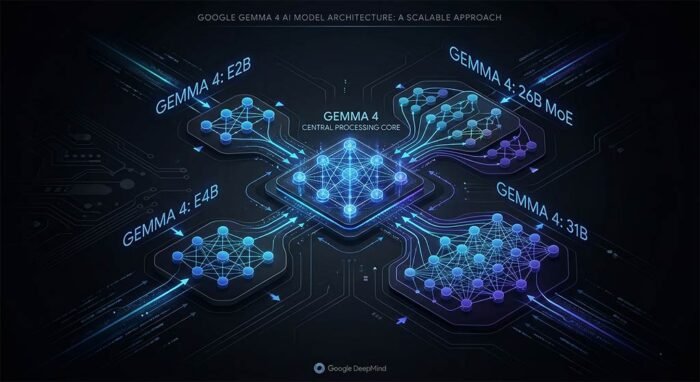

Une architecture déclinée pour tous les environnements matériels

Pour répondre aux besoins diversifiés de la communauté technologique, Google a conçu cette nouvelle itération en quatre tailles distinctes. On retrouve d’abord les versions E2B et E4B, où la lettre E signifie paramètres efficaces. Ces déclinaisons compactes ont été spécialement développées pour fonctionner sur des appareils mobiles, des systèmes embarqués ou des ordinateurs portables classiques. Elles exploitent des embeddings par couche pour maximiser les performances tout en limitant la consommation de mémoire vive.

Ensuite, pour les infrastructures plus robustes, Google propose un modèle dense de 31 milliards de paramètres (31B), considéré comme le plus puissant de la gamme, idéal pour les tâches de réglage fin complexes. Enfin, une version de 26 milliards de paramètres reposant sur une architecture de type mélange d’experts (MoE ou 26B A4B) vient compléter l’offre. Cette version n’active qu’une fraction de ses paramètres lors de l’inférence, ce qui permet d’obtenir un débit exceptionnellement élevé tout en conservant des capacités de raisonnement dignes des modèles tournant sur serveurs.

La licence apache 2.0 : une ouverture totale pour les développeurs

L’un des changements les plus marquants de ce lancement est la transition vers la licence Apache 2.0. Contrairement aux précédentes versions qui imposaient certaines restrictions d’utilisation, cette nouvelle politique offre une liberté totale. Les développeurs et les entreprises peuvent désormais utiliser, modifier, distribuer et commercialiser leurs applications basées sur cette technologie sans aucune contrainte juridique bloquante.

Cette décision stratégique permet à Google de renforcer considérablement son influence au sein de la communauté mondiale du développement logiciel. En supprimant les barrières à l’entrée, l’entreprise encourage l’adoption massive de son modèle par les startups, les chercheurs universitaires et les grands groupes industriels. Cela démontre une volonté claire de concurrencer les autres acteurs majeurs du secteur en misant sur la collaboration et la transparence, des valeurs essentielles pour repousser les limites de la recherche et favoriser une innovation saine.

Des capacités multimodales et un raisonnement logique inédit

Gemma 4 ne se contente pas de traiter du texte. Il s’agit d’une famille de modèles multimodaux capables d’analyser des images, des documents complexes et, spécifiquement pour les versions les plus légères, des flux audio. Cette polyvalence ouvre la voie à des applications novatrices telles que la reconnaissance optique de caractères avancée ou la transcription vocale enrichie par le contexte.

De plus, ces modèles bénéficient d’une fenêtre de contexte particulièrement vaste. Les versions optimisées pour le déploiement local peuvent ingérer jusqu’à 128 000 jetons simultanément, tandis que les versions plus massives atteignent les 256 000 jetons. Cela permet aux utilisateurs de soumettre des répertoires de code entiers ou des ouvrages volumineux en une seule requête. Sur le plan logique, l’entraînement spécifique sur des corpus mathématiques confère au modèle une aptitude remarquable pour le raisonnement symbolique et la résolution de problèmes par étapes. L’introduction de la prise en charge native du rôle système garantit également des interactions plus structurées et mieux contrôlées.

L’efficacité énergétique et le déploiement local au cœur de la stratégie

Au-delà des performances pures, l’optimisation de l’efficacité énergétique constitue un axe central de cette nouvelle génération. En permettant aux modèles de s’exécuter localement sur des terminaux grand public, Google réduit drastiquement la dépendance aux centres de données énergivores. Les requêtes n’ont plus besoin d’être systématiquement envoyées vers le cloud, ce qui diminue l’empreinte carbone globale liée à l’entraînement et à l’utilisation quotidienne de l’intelligence artificielle.

Ce traitement en local présente également un avantage majeur en matière de confidentialité. Les données sensibles des utilisateurs, qu’il s’agisse de documents personnels ou de secrets industriels, restent confinées sur l’appareil. La compatibilité est d’ailleurs étendue à une multitude de plateformes, allant des processeurs ARM des smartphones aux puces AppleAppleApple Apple Inc. est une entreprise technologique américaine fondée le 1er avril 1976 par Steve Jobs, Steve Wozniak et Ronald Wayne dans un garage de Los Altos, en Californie. Elle est aujourd'hui l'une des entreprises les plus valorisées et les plus influentes de l'histoire économique mondiale. Apple a révolutionné plusieurs industries successivement : l'informatique personnelle avec le Macintosh (1984), la musique numérique avec l'iPod et iTunes (2001), la téléphonie mobile avec l'iPhone (2007) — considéré comme l'un des produits les plus transformateurs du XXe siècle —, puis les tablettes avec l'iPad (2010) et les montres connectées avec l'Apple Watch (2015). Sa philosophie repose sur l'intégration verticale totale entre matériel, logiciel et services, créant un écosystème fermé mais remarquablement cohérent. Les puces Apple Silicon, développées en interne depuis 2020, ont redéfini les standards de performance et d'efficacité énergétique dans l'informatique portable. Apple emploie environ 160 000 personnes dans le monde et génère des revenus annuels dépassant les 380 milliards de dollars. Son influence culturelle dépasse largement le cadre technologique : le design minimaliste, l'expérience utilisateur soignée et la communication marketing de la marque ont durablement façonné l'esthétique et les usages numériques contemporains. Silicon, en passant par les architectures Windows classiques et même les cartes de prototypage comme le Raspberry Pi 5. Les développeurs mobiles peuvent même exploiter la version E2B directement via le nouveau composant Android AICore.

Une intégration optimisée pour la communauté open source

Pour garantir un succès immédiat, la firme a veillé à ce que son nouveau modèle soit directement compatible avec les outils les plus populaires du marché. Dès le premier jour, les poids des différents réseaux de neurones ont été rendus disponibles sur des plateformes incontournables telles que Hugging Face, Kaggle et Ollama.

Les ingénieurs peuvent également s’appuyer sur des environnements de travail reconnus comme Keras, vLLM ou encore llama.cpp pour intégrer rapidement ces intelligences artificielles dans leurs projets existants. En facilitant autant l’accès technique que juridique, Google s’assure que sa technologie devienne rapidement une norme. Cette synergie entre puissance, accessibilité, respect de l’environnement et ouverture d’esprit dessine les contours d’une nouvelle ère pour la création logicielle au sein du monde open source.

Google lance Gemma 4 : une révolution pour IA open source

Le 2 avril 2026, Google a franchi une nouvelle étape majeure dans le domaine de l’intelligence artificielle avec l’officialisation de Gemma 4. Présenté comme le modèle ouvert le plus performant de sa catégorie, il surpasse largement ses prédécesseurs. Cette nouvelle génération se distingue par une compréhension contextuelle affinée et des capacités de raisonnement logique de très haut niveau, tout en préservant une architecture légère qui favorise le déploiement local. À travers cette initiative, la firme de Mountain View ambitionne de démocratiser l’accès aux outils de pointe pour les chercheurs et les développeurs du monde entier, stimulant ainsi l’innovation au-delà des écosystèmes fermés traditionnels. Cette sortie marque un tournant stratégique décisif, équilibrant la puissance brute d’une IA générative avec une accessibilité sans précédent.

Une architecture déclinée pour tous les environnements matériels

Pour répondre aux besoins diversifiés de la communauté technologique, Google a conçu cette nouvelle itération en quatre tailles distinctes. On retrouve d’abord les versions E2B et E4B, où la lettre E signifie paramètres efficaces. Ces déclinaisons compactes ont été spécialement développées pour fonctionner sur des appareils mobiles, des systèmes embarqués ou des ordinateurs portables classiques. Elles exploitent des embeddings par couche pour maximiser les performances tout en limitant la consommation de mémoire vive.

Ensuite, pour les infrastructures plus robustes, Google propose un modèle dense de 31 milliards de paramètres (31B), considéré comme le plus puissant de la gamme, idéal pour les tâches de réglage fin complexes. Enfin, une version de 26 milliards de paramètres reposant sur une architecture de type mélange d’experts (MoE ou 26B A4B) vient compléter l’offre. Cette version n’active qu’une fraction de ses paramètres lors de l’inférence, ce qui permet d’obtenir un débit exceptionnellement élevé tout en conservant des capacités de raisonnement dignes des modèles tournant sur serveurs.

La licence apache 2.0 : une ouverture totale pour les développeurs

L’un des changements les plus marquants de ce lancement est la transition vers la licence Apache 2.0. Contrairement aux précédentes versions qui imposaient certaines restrictions d’utilisation, cette nouvelle politique offre une liberté totale. Les développeurs et les entreprises peuvent désormais utiliser, modifier, distribuer et commercialiser leurs applications basées sur cette technologie sans aucune contrainte juridique bloquante.

Cette décision stratégique permet à Google de renforcer considérablement son influence au sein de la communauté mondiale du développement logiciel. En supprimant les barrières à l’entrée, l’entreprise encourage l’adoption massive de son modèle par les startups, les chercheurs universitaires et les grands groupes industriels. Cela démontre une volonté claire de concurrencer les autres acteurs majeurs du secteur en misant sur la collaboration et la transparence, des valeurs essentielles pour repousser les limites de la recherche et favoriser une innovation saine.

Des capacités multimodales et un raisonnement logique inédit

Gemma 4 ne se contente pas de traiter du texte. Il s’agit d’une famille de modèles multimodaux capables d’analyser des images, des documents complexes et, spécifiquement pour les versions les plus légères, des flux audio. Cette polyvalence ouvre la voie à des applications novatrices telles que la reconnaissance optique de caractères avancée ou la transcription vocale enrichie par le contexte.

De plus, ces modèles bénéficient d’une fenêtre de contexte particulièrement vaste. Les versions optimisées pour le déploiement local peuvent ingérer jusqu’à 128 000 jetons simultanément, tandis que les versions plus massives atteignent les 256 000 jetons. Cela permet aux utilisateurs de soumettre des répertoires de code entiers ou des ouvrages volumineux en une seule requête. Sur le plan logique, l’entraînement spécifique sur des corpus mathématiques confère au modèle une aptitude remarquable pour le raisonnement symbolique et la résolution de problèmes par étapes. L’introduction de la prise en charge native du rôle système garantit également des interactions plus structurées et mieux contrôlées.

L’efficacité énergétique et le déploiement local au cœur de la stratégie

Au-delà des performances pures, l’optimisation de l’efficacité énergétique constitue un axe central de cette nouvelle génération. En permettant aux modèles de s’exécuter localement sur des terminaux grand public, Google réduit drastiquement la dépendance aux centres de données énergivores. Les requêtes n’ont plus besoin d’être systématiquement envoyées vers le cloud, ce qui diminue l’empreinte carbone globale liée à l’entraînement et à l’utilisation quotidienne de l’intelligence artificielle.

Ce traitement en local présente également un avantage majeur en matière de confidentialité. Les données sensibles des utilisateurs, qu’il s’agisse de documents personnels ou de secrets industriels, restent confinées sur l’appareil. La compatibilité est d’ailleurs étendue à une multitude de plateformes, allant des processeurs ARM des smartphones aux puces Apple Silicon, en passant par les architectures Windows classiques et même les cartes de prototypage comme le Raspberry Pi 5. Les développeurs mobiles peuvent même exploiter la version E2B directement via le nouveau composant Android AICore.

Une intégration optimisée pour la communauté open source

Pour garantir un succès immédiat, la firme a veillé à ce que son nouveau modèle soit directement compatible avec les outils les plus populaires du marché. Dès le premier jour, les poids des différents réseaux de neurones ont été rendus disponibles sur des plateformes incontournables telles que Hugging Face, Kaggle et Ollama.

Les ingénieurs peuvent également s’appuyer sur des environnements de travail reconnus comme Keras, vLLM ou encore llama.cpp pour intégrer rapidement ces intelligences artificielles dans leurs projets existants. En facilitant autant l’accès technique que juridique, Google s’assure que sa technologie devienne rapidement une norme. Cette synergie entre puissance, accessibilité, respect de l’environnement et ouverture d’esprit dessine les contours d’une nouvelle ère pour la création logicielle au sein du monde open source.

En ce moment :

Chargement…Horloge GorgyTime Widget Rechercher

Les derniers articles

Plus d'infos

- Glossaire

- Faq (aide)

- Qui sommes nous

- Plan du Site

- Conditions générales

- Mentions légales

- Politique de confidentialité